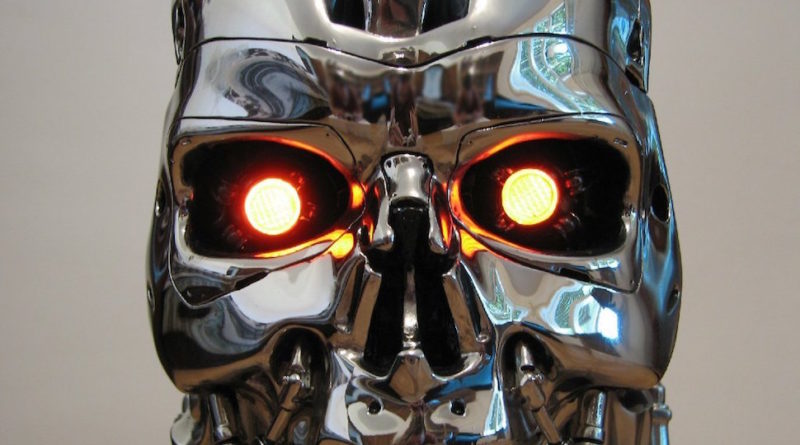

Intelligenza artificiale, il team di Elon Musk: “Pericolo di cyber-attacchi, a rischio integrità dei governi”

La AI rischia di trasformarsi in un’arma in mano a cybercriminali e Stati senza scrupoli. L’allarme arriva da uno studio condotto da un gruppo di ricercatori delle Università di Cambridge, Oxford e Yal, coadiuvati dal gruppo di ricerca OpenAI fondato dall’imprenditore Elon Musk e da esperti di privacy e questioni militari.

L’intelligenza artificiale – se violata dagli hacker – rischia di prestarsi ad una serie di usi criminosi che minacciano la sicurezza. Secondo lo studio, la tecnologia potrebbe essere usata per insegnare alle macchine a diventare hacker, sferrando cyberattacchi automatizzati più potenti.

La minaccia è anche alla sicurezza fisica: i criminali potrebbero prendere il controllo delle auto autonome, causando incidenti, e dei droni, trasformandoli in armi rivolte verso obiettivi mirati. Infine, l’Intelligenza artificiale minaccia la sicurezza politica, attraverso una sorveglianza che azzera la privacy o la repressione. Ancora, potrebbe essere usata per creare video falsi, ma realistici, che vedono i politici come ignari protagonisti, allo scopo di fare propaganda. “Viviamo in un mondo che potrebbe diventare irto di pericoli quotidiani a causa di un uso cattivo dell’AI – avverte Sean O hEigeartaigh, direttore del Centro per lo studio del rischio esistenziale dell’ateneo di Cambridge -. I rischi sono reali. Ci sono scelte che dobbiamo fare ora: il nostro rapporto è una chiamata all’azione per governi, istituzioni e singoli individui in tutto il mondo”.

L’intelligenza artificiale – se violata dagli hacker – rischia di prestarsi ad una serie di usi criminosi che minacciano la sicurezza. Secondo lo studio, la tecnologia potrebbe essere usata per insegnare alle macchine a diventare hacker, sferrando cyberattacchi automatizzati più potenti.

La minaccia è anche alla sicurezza fisica: i criminali potrebbero prendere il controllo delle auto autonome, causando incidenti, e dei droni, trasformandoli in armi rivolte verso obiettivi mirati. Infine, l’Intelligenza artificiale minaccia la sicurezza politica, attraverso una sorveglianza che azzera la privacy o la repressione. Ancora, potrebbe essere usata per creare video falsi, ma realistici, che vedono i politici come ignari protagonisti, allo scopo di fare propaganda. “Viviamo in un mondo che potrebbe diventare irto di pericoli quotidiani a causa di un uso cattivo dell’AI – avverte Sean O hEigeartaigh, direttore del Centro per lo studio del rischio esistenziale dell’ateneo di Cambridge -. I rischi sono reali. Ci sono scelte che dobbiamo fare ora: il nostro rapporto è una chiamata all’azione per governi, istituzioni e singoli individui in tutto il mondo”.